現地時間4月23日、MetaはRay-Banと共同で開発したスマートグラス 「Ray-Ban Meta Smart Glass」 に、複数の新機能を追加すると発表した。

導入される新機能は、以下の2つ。

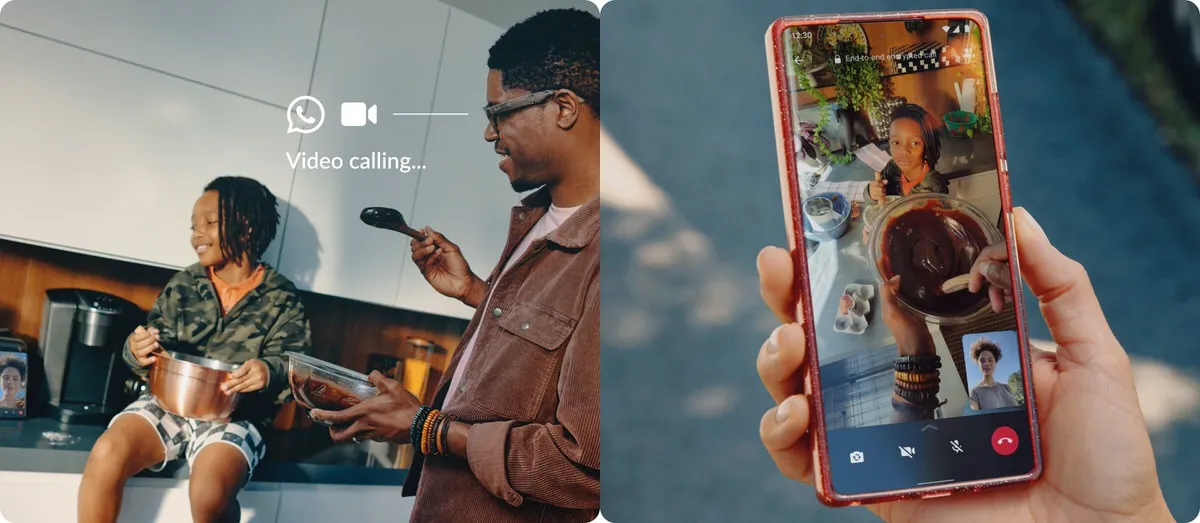

- WhatsAppとMessengerを使ったビデオ通話機能。ビデオ通話中に装着者の視点を共有可能。

- スマートグラスで撮影した写真に映るものをMetaのAI で検索する機能。外国語の翻訳も可能。

関連リンク:New Ray-Ban | Meta Smart Glasses Styles and Meta AI Updates | Meta

まずはビデオ通話機能についてだが、これはWhatsAppとMessengerのビデオ通話をする際、スマートグラスを装着している人の視点が通話相手に共有されるというもの。

ARグラスではないためサングラスに通話相手が表示されることはないものの、同スマートグラス所有者は新しいコミュニケーション方法を獲得することができそうだ。本日より徐々にロールアウトされ、利用できるようになる予定。

Metaは利用シチュエーションとして、スーパーでどのブランドの昆布茶を買えばいいかわからないときや、パイナップルがどれだけ熟しているかがわからないとき、お母さんにビデオ電話で繋がりアドバイスを受けてみる、という例を挙げている。日本では少ないが、海外では自分の目の前の景色を、通話相手にスマートフォンで見せながら歩く人もいることから一定の需要はある機能かもしれない。

次は、MetaのマルチモーダルAIアシスタント 「Meta AI」 を利用した機能。マルチモーダルとは、画像や動画、音声、テキストなど複数種類のデータを同時に処理することを指す言葉で、スマートグラスに内蔵された1200万画素の超広角カメラで撮影した写真から、見ているものが何なのかをAIに聞くことができるというものだ。まずは、米国とカナダでベータ版として提供される。

例えば目の前の植物や果物の名前を知りたいとき、「Hey Meta」 というウェイクワードとともに質問すれば、目の前のものについて解説してくれる。また、あなたがもしフランス旅行に行っているとき、レストランのメニューを読もうとしたときに、書いてあるメニューの内容を母国語に翻訳してもらうことも可能だ。

さらに、Metaはスカイラーフレームという新しいフレームに加えて、スマートグラスが鼻から滑り落ちたり、顔に近づきすぎるユーザー向けにローブリッジオプションを追加すると発表した。

Ray-Banリミックスプラットフォームから数百種類のカスタムフレームとレンズを組み合わせて、自分だけのスマートグラスを作ることができる。また、処方レンズに対応する。

これらの新しいスタイルは、米国/カナダ/欧州/オーストラリアの15カ国で利用可能。日本では残念ながら利用できない。

また、The Vergeによるとプレスリリースには書かれていないものの、「Ray-Ban Meta Smart Glass」 は新たにApple Musicの利用が可能になったとのことだ。

(画像:Meta)