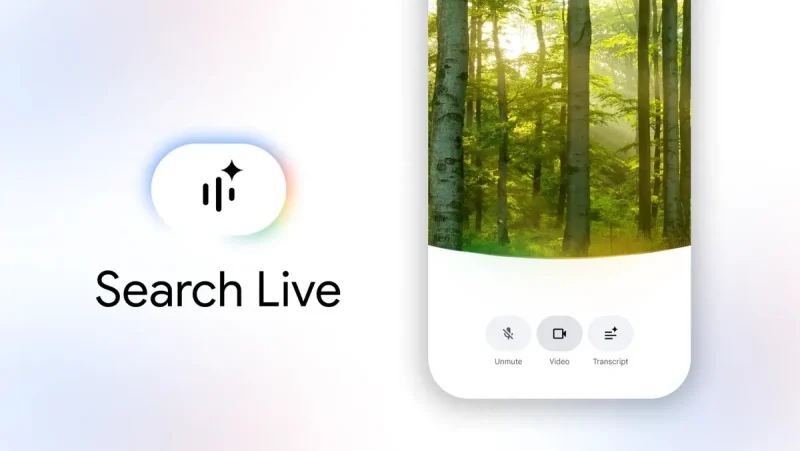

Googleは3月27日、AI検索機能「検索 Live(Search Live)」のグローバル展開を発表した。これにより、同機能はAIモードに対応する200以上の国と地域、すべての対応言語で利用可能となった。

音声とカメラで「会話する検索」を世界展開

「検索 Live」は、音声およびカメラ入力を用いて検索とリアルタイムに対話できる機能。ユーザーはスマートフォンのカメラで対象物を映しながら質問し、その場で音声による回答や関連リンクを取得できる。従来のテキスト入力中心の検索から、より直感的で状況依存型の検索体験へと拡張するものだ。

同機能は2025年に発表・提供開始された後、これまで一部地域での利用に限定されていたが、今回のアップデートにより対象地域を大幅に拡大。日本を含むAIモード対応地域すべてで利用できるようになった。

利用方法としては、AndroidおよびiOSのGoogleアプリの検索バーの下に表示される「ライブ」アイコンをタップすることで起動可能。さらに「Google レンズ」経由でも同様の体験が提供され、カメラ映像をもとに対話的な検索が行える。

Gemini 3.1 Flash Liveで多言語・低遅延化

今回のグローバル展開を支えるのが、新たに導入された音声・対話特化モデル「Gemini 3.1 Flash Live」だ。同モデルはネイティブで多言語に対応し、より自然でスムーズな会話体験を実現するという。

従来モデルからの進化点として、応答速度の向上や会話の自然さが強化されており、ユーザーは母国語でそのまま検索と対話が可能になる。こうした特性により、検索はリアルタイムの問題解決や作業支援へと役割を広げつつある。

Googleは本機能について、キーボード入力では不十分な場面、例えば目の前の物体に関する疑問や作業手順の確認などにおいて有効と説明している。カメラが捉えた視覚情報と音声入力を組み合わせることで、検索はより状況理解型のインターフェースへ進化する。

今回の展開により、AIを中核とした検索体験のグローバル標準化が一段と進む形だ。

関連リンク

- 検索 Live を日本で提供開始 – Google Japan Blog

- Gemini 3.1 Flash Live: Google’s latest AI audio model – Google The Keyword

(画像:Google)